Potenciál a úloha UI

UI je základným komponentom automatizácie vozidiel a jej využitie ovplyvní mnohé procesy [25]:

- na politickej úrovni musí byť stanovené, za akých podmienok sú/budú vozidlá (s rôznym stupňom automatizácie) považované za bezpečné; obzvlášť dôležité môžu byť „okrajové prípady“ alebo nezvyčajné situácie, ktoré sa nemusia vyskytnúť ani pri testovaní;

- podobne ako v prípade konvenčných vozidiel bude vo verejnom záujme identifikovať problémy s bezpečnosťou a vyšetrovať príčiny nehôd – zatiaľ čo pre vývojárov UI je vznik nehody príležitosťou na vylepšenie techník strojového učenia, pre vyšetrovateľov a zodpovedné orgány bude na stole otázka, akým dielom UI prispela k nehode – nájsť odpoveď však môže byť pri UI systémoch viac ako veľmi zložité;

- automatizované vozidlá a systémy UI musia byť chránené pred škodlivými kybernetickými útokmi; útok hackerov je najsamozrejmejším príkladom, slabinou systému však môže byť napr. oklamanie systému počítačového videnia falošným svetelným zdrojom alebo signálom, v dôsledku čoho zareaguje systém nebezpečným spôsobom.

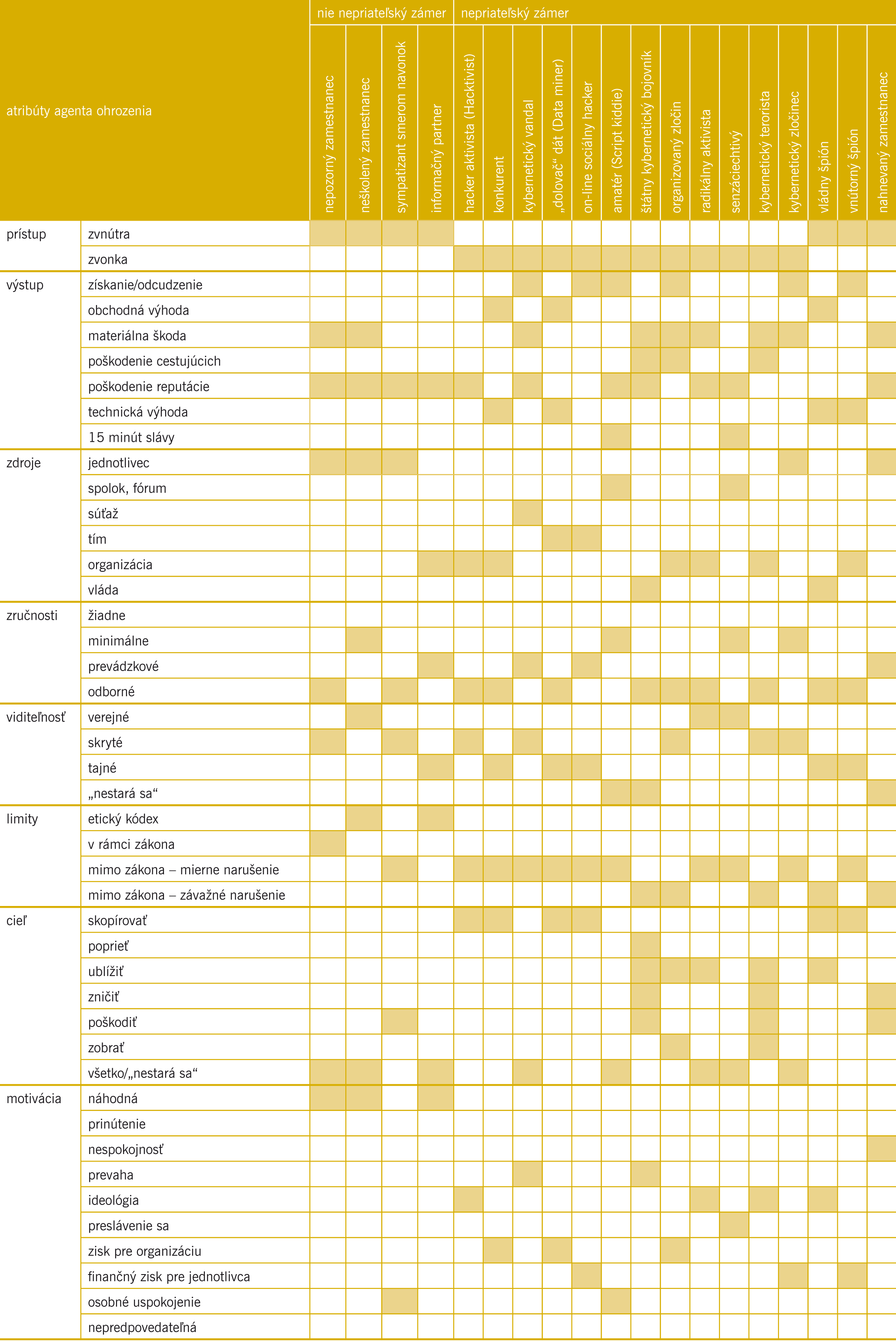

Obr. 3 ukazuje dekompozíciu ekosystému vozidla prepojeného na jednotlivé, vzájomne pospájané podsystémy (publikovaný v 1. časti seriálu v ATP Journal 7/2019, s. 49). V tab. 5 je na ilustráciu uvedená knižnica klasifikujúca agenty ohrozenia v automobilovom priemysle podľa [17], rozdeľujúca ich podľa zámerov na nie priateľské a nepriateľské (tab. 5 nájdete vo fotogalérii pod článkom). Ten istý zdroj uvádza aj knižnicu metód a cieľov (MOL – Methods and Objectives Library) a knižnicu všeobecných expozícií, resp. vystavení sa rizikám (CEL – Common Exposure Library), aplikované na CAV. Knižnice sa neustále vyvíjajú a nemožno ich považovať za kompletné.

Cieľom bezpečnostných útokov môžu byť všetky piliere, na ktorých stojí kybernetická bezpečnosť. Podľa [18] sú to v prípade automobilových aplikácií štyri základné piliere:

- základňa pre návrh a implementáciu UI,

- vývojová infraštruktúra podporujúca hlboké učenie,

- riešenie dátového centra na robustnú simuláciu a testovanie,

- pervazívny bezpečnostný program.

Vyšší počet prepojení (Car2Cloud, LTE, WiFi atď.) s vonkajším svetom zvyšuje bezpečnostné hrozby. Problémy sú v štyroch hlavných oblastiach [17]:

- bezdrôtové aktualizácie (OTA – Over-The-Air updates),

- nízky výpočtový výkon (na rozdiel od potenciálne vysokého výkonu útočiacich počítačov),

- obťažné monitorovanie stavu elektroniky certifikovanou autoritou (vozidlo nie je vždy pripojené na internet),

- náklady na zabezpečenie SW (v zmysle slova security),

- bez security nie je ani safety – jedno infikované vozidlo môže predstavovať potenciálne nebezpečenstvo pre všetky ostatné.

Uvedené problémy a snaha o ich riešenie sa významným spôsobom premietajú do tvorby otvorenej systémovej architektúry automobilov AUTOSAR (Automotive Open System Architecture, www.autosar.org), ktorá je v súčasnosti de facto štandardom pre výrobcov originálnych zariadení (OEM) a ich dodávateľov v automobilovom priemysle a je v súlade s „automobilovými štandardmi“ ako ISO 15767, ISO 14229, ISO 27145 atď.

Metódy strojového učenia

Umelá inteligencia (UI) má potenciál pomôcť pri identifikovaní zraniteľných miest a ich odstraňovaní, pri detekcii útokov a obrane proti aktívnym útokom. Pomáha nám riešiť zložité problémy spôsobom, akým by to robil sám človek. Mechanizmus rozhodovania podobný ľudskému mechanizmu rozhodovania sa tak snažíme modelovať pomocou nejakých algoritmov. Využívajú sa neurónové siete (pri detekcii DoS, červov, spamu, zombie a klasifikácii škodlivého SW a pod., keď sa cení najmä ich vysoká rýchlosť), expertné systémy (napr. pri výbere bezpečnostných opatrení), inteligentné agenty (ochrana proti DDoS útokom), prehľadávanie (najmä informované), strojové učenie (SU) a pod.

SU je podoblasťou UI, ktorá dáva počítačom možnosť učiť sa bez explicitného naprogramovania. Počítačové programy sa tak po vystavení novým údajom môžu meniť. Dôvodom súčasnej popularity SU je skutočnosť, že máme také množstvo údajov ako nikdy predtým (veľké dáta) a potrebujeme, aby dávali nejaký zmysel, pretože už je pre človeka obťažné ich analyzovať. SU tak spolu s ľudskou expertízou pomáhajú budovať prediktívne modely kybernetických útokov.

Strojové učenie

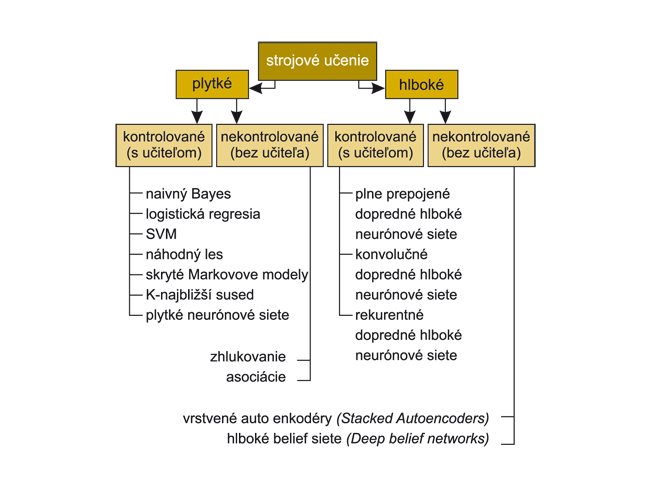

SU zahŕňa veľké množstvo neustále sa vyvíjajúcich paradigiem, ktoré majú vzájomné vzťahy a niekedy prekrývajúce sa hranice. Rôzne pohľady a aplikácie tak môžu viesť k rôznym klasifikáciám. Na obr. 4 je klasifikácia ML algoritmov na účely kybernetickej bezpečnosti podľa [20].

Tradičné algoritmy SU sú uvádzané ako „plytké učenie“ (Shallow Learning), ako opak k „hlbokému učeniu“ (Deep Learning). Prvá kategória vyžaduje doménového experta, ktorý je schopný identifikovať kritickú úlohu určenia relevantných charakteristík dát pred vykonaním samotného algoritmu. Druhá kategória sa spolieha na multivrstvovú reprezentáciu vstupných dát a môže vybrať príznaky autonómne v procese nazvanom učenie reprezentácií (Representation Learning). Treba poznamenať, že každá kategória môže obsahovať desiatky rôznych techník.

Naivný Bayes (Naive Bayes)

Tieto algoritmy sú pravdepodobnostné klasifikátory, ktoré vychádzajú z apriórneho predpokladu, že príznaky vstupného súboru údajov sú navzájom nezávislé. Sú škálovateľné a nevyžadujú veľké trénovacie množiny dát na to, aby dosiahli slušné výsledky.

Logistická regresia (Logistic Regression)

Ide o kategorické klasifikátory, ktoré využívajú diskriminačný model. Podobne ako v predošlom prípade, aj tieto algoritmy predpokladajú apriórnu nezávislosť prevzatia vstupných funkcií. Ich výkon závisí vo veľkej miere od veľkosti trénovacej množiny.

Metóda podporných vektorov (Support Vector Machines)

Ide o nepravdepodobnostné klasifikátory, ktoré mapujú vzorky údajov v priestore objektov príznakov s cieľom maximalizovať vzdialenosť medzi každou kategóriou vzoriek. Nevytvárajú žiadny predpoklad o vstupných príznakoch, v klasifikáciách s viacerými triedami však pracujú zle. Preto by sa mali používať ako binárne klasifikátory. Ich obmedzená škálovateľnosť môže viesť k dlhým časom spracovania.

Náhodný les (Random Forest)

Ide o súbor rozhodovacích stromov, ktorý berie do úvahy výstup každého stromu pred poskytnutím jednotnej konečnej odpovede. Každý rozhodovací strom je podmienený klasifikátor: strom je prechádzaný zhora nadol a v každom uzle sa kontroluje daná podmienka vzhľadom na jeden alebo viaceré príznaky analyzovaných údajov. Tieto metódy sú účinné pri veľkých súboroch údajov a vynikajú pri problémoch s viacerými triedami. Hlbšie stromy môžu viesť k preučeniu.

Skryté Markovove modely (Hidden Markov Models)

Modelujú systém ako súbor stavov produkujúcich výstupy s rôznou pravdepodobnosťou; cieľom je určiť postupnosť stavov, ktorá vedie k pozorovaným výstupom. Umožňujú pochopiť časové správanie pozorovaní a vypočítať pravdepodobnosť danej sekvencie udalostí. Hoci môžu byť trénované na klasifikovaných a neklasifikovaných súboroch údajov, v kybernetickej bezpečnosti sa zväčša používajú s klasifikovanými údajmi.

Najbližší sused K (K-Nearest Neighbour)

Metóda sa používa na klasifikáciu a možno ju použiť na riešenie problémov s viacerými triedami. Ich učiaca a testovacia fáza sú však výpočtovo náročné, pretože pri klasifikovaní každej testovanej vzorky ju porovnávajú so všetkými vzorkami v trénovacej množine.

Plytká neurónová sieť (Shallow Neural Network)

Algoritmy sú založené na neurónových sieťach, ktoré pozostávajú z množiny neurónov organizovaných v dvoch alebo vo viacerých komunikujúcich vrstvách. Zahŕňajú všetky typy neurónových sietí s obmedzeným počtom neurónov a vrstiev. Napriek existencii nekontrolovanej plytkej neurónovej siete (bez učiteľa) sa v oblasti kybernetickej bezpečnosti používajú najčastejšie na klasifikačné úlohy.

Zhlukovanie (Clustering)

Metóda zhlukuje dátové body, ktoré majú podobné charakteristiky. K dobre známym prístupom patrí metóda k priemerov (k-means) a hierarchické zhlukovanie. Metódy zhlukovania majú obmedzenú škálovateľnosť, ale predstavujú flexibilné riešenie, ktoré sa typicky používa ako predbežná fáza pred prijatím kontrolovaného algoritmu (s učením) alebo na detekciu anomálií.

Asociácie (Associations)

Cieľom je identifikovať neznáme vzory medzi údajmi, čo ich robí vhodnými na predikciu. Majú však tendenciu produkovať nadmerný výkon nie nevyhnutne platných pravidiel, a preto musia byť kombinované s presnou kontrolou zo strany ľudského experta.

Plne prepojené dopredné hlboké neurónové siete(Fully-connected Feedforward Deep Neural Networks)

Variant hlbokej neurónovej siete, kde je každý neurón pripojený k všetkým neurónom predchádzajúcej vrstvy. Nevytvára žiadny predpoklad o vstupných údajoch a poskytuje flexibilné a univerzálne riešenie na klasifikáciu za cenu vysokých výpočtových nákladov.

Konvolučné dopredné hlboké neurónové siete (Convolutional Feedforward Deep Neural Networks)

Variant hlbokej neurónovej siete, kde každý neurón prijíma svoj vstup len z podmnožiny neurónov predchádzajúcej vrstvy. Táto vlastnosť robí sieť efektívnou pri analýze priestorových údajov, ale jej výkon sa znižuje, keď sa aplikuje na nepriestorové dáta. Má nižšie výpočtové náklady ako predošlá sieť.

Rekurentné hlboké neurónové siete (Recurrent Deep Neural Networks)

Variant hlbokej neurónovej siete, ktorej neuróny môžu posielať svoj výstup aj do predchádzajúcich vrstiev; tento dizajn spôsobuje, že sa učia horšie plne prepojené neurónové siete. Vynikajú ako sekvenčné generátory, najmä ich posledný variant, veľká krátkodobá pamäť.

Vrstvené autoenkodéry (Stacked Autoencoders)

Skladajú sa z viacerých autoenkodérov, triedy neurónových sietí, kde je počet vstupných a výstupných neurónov rovnaký. Vynikajú v úlohách predučenia a v malých súboroch údajov dosahujú lepšie výsledky ako nasledujúca metóda.

Hlboké belief siete (Deep Belief Networks)

Sú modelované prostredníctvom zostavy tzv. Restricted Boltzmann Machines, triedy neurónových sietí bez výstupnej vrstvy. Môžu sa úspešne použiť na úlohy predučenia, pretože vynikajú vo funkcii extrakcie vlastností. Vyžadujú fázu učenia, ale so súbormi neklasifikovaných údajov (bez učiteľa).

Pokiaľ ide o najčastejšie aplikácie v oblasti kybernetickej bezpečnosti, kde možno uvedené metódy SU v súčasnosti nájsť, ide o detekciu nepovoleného vstupu (intrusion detection), analýzu škodlivého softvéru (malware analysis) a detekciu spamu a neoprávneného získavania údajov (spam and phishing detection). Podrobnejší pohľad na aplikáciu uvedených algoritmov pre ten-ktorý typ uvažovaného útoku je v [21]. Autonómne schopnosti algoritmov SU sa nesmú preceňovať, pretože absencia ľudského dohľadu môže kvalifikovaným útočníkom uľahčiť preniknutie, odcudzenie údajov a dokonca sabotovanie činnosti celku (systému, podniku, služby). O šiestich rôznych dimenziách, ktoré prináša prienik UI, SU a kybernetickej bezpečnosti, sa diskutuje v [16] – legislatívne a politické otázky, ľudský faktor, dáta, hardvér, softvér, algoritmy a uvedenie do prevádzky (sfunkčnenie). Ďalší pohľad na techniky UI aplikované v oblasti kybernetickej bezpečnosti (v členení na expertné systémy, neurónové siete a inteligentné agenty) možno nájsť napr. v [22].

Bayesovské siete

Častou kritikou metód SU je konštatovanie, že je nemožné alebo obťažné predikovať budúcnosť na základe historických dát, namiesto toho by sa mali využívať poznatky. Prekážkou pri tvorbe realistických modelov je nedostatok relevantného množstva historických dát opisujúcich bezpečnostné narušenia, incidenty a hrozby. Jedným z prístupov ponúkajúcich riešenie sú bayesovské siete (BBN – Bayesian Belief Networks) z rodiny pravdepodobnostných grafických modelov, ktoré spájajú kvantitatívne a kvalitatívne poznatky. Nielen o teoretickom pozadí daného formalizmu sa možno dočítať napr. v učebnici [23]. Systematický prehľad BBN modelov v oblasti kybernetickej bezpečnosti je v [24].

Záver

Existuje jemný, ale pritom zásadný rozdiel medzi „myslieť ako človek“ („silná UI“) a „vykonávať intelektuálne úlohy ako človek“ („všeobecná UI“). Zatiaľ prevládajú aplikácie „slabej UI“. Je zrejmé, že zväzku UI, kybernetickej bezpečnosti a automatizovaných vozidiel patrí budúcnosť, to však platí v dobrom aj v zlom – na jednej strane sa môže UI stať efektívnym nástrojom v rukách útočníkov, na druhej strane si bez UI ťažko predstaviť úspešný rozvoj automatizácie automobilového priemyslu, návrh, testovanie, overovanie, prevádzku a zaistenie bezpečnosti používateľov automatizovaných vozidiel. Napriek tomu, že vznikajúce algoritmy sú čoraz inteligentnejšie, je súčasná UI stále veľmi nedokonalá a ľudskí experti sú stále dôležitejší ako ona. Metódy kontrolovaného SU (s učiteľom) sa učia na príkladoch správania škodlivého SW a prejavoch rôznych techník útoku a pomáhajú tak pri klasifikácii škodlivého SW, identifikácii spamu či analýze veľkých objemov firewallových dát s cieľom predikovať a hodnotiť škodlivé IP adresy. Metódy nekontrolovaného SU (bez učiteľa) sa využívajú na rozličné analýzy (klasifikáciu doménových mien a početnosti vyhľadávaní, priorizáciu IOC), zväčša s využitím prístupov založených na štatistike a pravidlách, a určujú, čo je normálne pre jedinečné charakteristiky chráneného prostredia.

Existujú mnohé technologické výzvy, ktorým sa treba v oblasti kybernetickej bezpečnosti venovať:

- dostupnosť a kvalita trénovacích dát – obsahujú množstvo citlivých informácií (intelektuálne vlastníctvo, osobné identifikačné dáta a pod.);

- overovanie a testovanie naučených modelov v reálnych podmienkach;

- neustály vývoj kybernetickej bezpečnosti (potreba neustálej aktualizácie, rozširovania a opakovaného trénovania modelov).

Prezentovaný jednoduchý model bayesovskej siete ukazuje jeden z možných prístupov, ktorý je v ostatnom čase často skloňovaný a vedený snahou o zapracovanie a využitie expertízy ľudských expertov do rozhodovacích (v tomto prípade pravdepodobnostných) modelov.

Poďakovanie

Tento článok vznikol s podporou agentúry KEGA v rámci projektu 014ŽU-4/2018 Rozšírenie obsahu študijného odboru o aktuálne požiadavky praxe v oblasti metód umelej inteligencie a IT.

Literatúra

[1] BOSTROM, N.: Superintelligence. Paths, Dangers, Strategies. Oxford University Press 2014. ISBN 978-0-19-967811-2.

[2] URBAN, T.: The AI Revolution: The Road to superintelligence. Wait But Why? [online]. Dostupné na: https://waitbutwhy.com/2015/01/artificial-intelligence-revolution-1.html.

[3] Asilomar AI Principles. [online]. Dostupné na: https://futureoflife.org/ai-principles/?submitted=1#confirmation.

[4] SAE J3016TM Levels of Driving Automation. SAE International 2018.

[5] COM(2018) 283 final: Na ceste k automatizovanej mobilite: stratégia EÚ pre mobilitu budúcnosti. Oznámenie komisie Európskemu parlamentu, Rade, Európskemu hospodárskemu a sociálnemu výboru, výboru regiónov. 2018.

[6] Preparing for the future of transportation. Automated vehicles 3.0. U. S. Department of Transportation, October 2018.

[7] The state of security regulation in the connected car ecosystem. Challenges, dilemmas and stakeholders’ interests. E-book, Upstream Security Ltd. 2018.

[8] Digital Single Market. Policy. Cybersecurity, EK 2018. [online]. Dostupné na: https://ec.europa.eu/digital-single-market/en/cyber-security.

[9] Intelligent Transport Systems: Cooperative, connected and automated mobility (CCAM). EK 2019. [online]. Dostupné na: https://ec.europa.eu/transport/themes/its/c-its_en.

[10] Accelerating the Next Revolution in Roadway Safety. Federal Automated Vehicles Policy, NHTSA, Sept 2016.

[11] Cybersecurity best practices for modern vehicles. Report No. DOT HS 812 333, NHTSA, Oct 2016.

[12] TOKODY, D. et al.: Safety and security through the design of autonomous intelligent vehicle systems and intelligent infrastructure in the smart city. Interdisciplinary Description of Complex Systems, 16(3-A), 384-396, 2018.

[13] Q1 2019 sees rapid growth of automotive cyber incidents. Upstream Security Ltd. 2019.

[14] Upstream security global automotive cybersecurity report 2019. Research into smart mobility cyber attacks trends. Upstream Security Ltd. 2019.

[15] GOLDBERG, J.: Traditional IT Cyber Security vs. Automotive Cyber Security Explained. Guard Knox, March 2018.

[16] Artificial Intelligence and Machine Learning Applied to Cybersecurity. The results of an intensive three-day IEEE Confluence. IEEE, 6-8 October 2017.

[17] KARAHASANOVIC, A.: Automotive Cyber Security. Threat modelling of the AUTOSAR standard. MSc. thesis, Chalmers University of Technology, Gothenburg 2016.

[18] Self-driving Safety Report. NVIDIA Report, 2018.

[19] WATNEY, C. – DRAFFIN, C.: Addressing New Challenges in Automotive Security. R Street Policy Study, No. 118, Nov. 2017.

[20] APRUZZESE, G. et al.: On the Effectiveness of Machine and Deep Learning for Cyber Security. 10th Int. Conference on Cyber Conflict (CyCon), IEEE 2018. to isté? ak sa omylom zopakovalo, treba upraviť odkazy aj v texte

[21] APRUZZESE, G. et al.: On the Effectiveness of Machine and Deep Learning for Cyber Security. 10th Int. Conference on Cyber Conflict (CyCon), IEEE 2018.

[22] PANIMALAR, A. S. et al.: Artificial Intelligence Techniques for Cyber Security. In: International Research Journal of Engineering and Technology (IRJET), 2018, Vol. 5, Issue 3.

[23] GREGOR, M. – JANOTA, A. – HRUBOŠ, M.: Kompendium vybraných metód umelej inteligencie 1. VŠ učebnica. Žilinská univerzita v Žiline 2018. 211 s.

[24] CHOCKALINGAM, S. et al.: Bayesian Network Models in Cyber Security: A Systematic Reviews. Proc. of the Nordic Conference on Secure IT Systems (Nordic 2017), TU Delft, 2017.

prof. Ing. Aleš Janota, PhD., EurIng

Ing. Roman Michalík

Žilinská univerzita

Fakulta elektrotechniky a informačných technológií

Katedra riadiacich a informačných systémov

Univerzitná 1, 010 26 Žilina

Tel.: +421 41 513 3356

ales.janota@fel.uniza.sk

roman.michalik@fel.uniza.sk